Anthropic 於 2026 年初發布了《2026 Agentic Coding Trends Report》,提出了 8 大趨勢預測。作為一名在企業級系統架構領域深耕多年的架構師,我將逐一拆解每個趨勢,結合實際的代理操作經驗,為你呈現這份報告背後的深層意涵。

🏗️ 基礎趨勢:地殼級的轉變

趨勢 1:軟體開發生命週期(SDLC)將劇烈改變

架構師視角

這不只是「AI 幫你寫 code」這麼簡單。報告指出,從機器碼到組合語言、從 C 到現代高階語言,每一層抽象都在縮短人類思維與機器執行之間的距離。而 Agentic AI 是這條演化路線上最新的一步——人機對話式程式開發。

作為架構師,我看到的核心轉變是:工程師的角色從「實作者」變成「指揮者」。這就像軍隊中從士兵升為指揮官——你不再親自衝鋒陷陣,而是制定戰略、分配資源、審查成果。

報告特別提到一個關鍵數據:工程師約 60% 的工作使用 AI,但只有 0-20% 能完全委派。這說明了一個事實——AI 是協作者,不是替代者。你仍然需要深厚的工程知識來判斷 AI 產出的品質。

實戰操作:如何用 Coding Agent 重塑你的 SDLC

場景一:快速上手陌生程式碼庫

報告指出新人上手時間將從數週壓縮到數小時。以下是實際操作方式:

# 使用 Claude Code 探索陌生程式碼庫

# 步驟 1:讓代理理解整體架構

$ claude "分析這個專案的整體架構,包括主要模組、依賴關係、資料流向"

# 步驟 2:針對特定模組深入了解

$ claude "解釋 src/auth/ 目錄下的認證機制,包括 token 生命週期和刷新策略"

# 步驟 3:理解業務邏輯

$ claude "追蹤一個訂單從建立到完成的完整流程,列出涉及的所有服務和資料表"

場景二:架構決策輔助

# 讓代理幫你評估架構方案

$ claude "我們正在考慮將單體應用拆分為微服務。

分析目前的程式碼耦合度,識別可以獨立拆分的邊界上下文(Bounded Context),

並評估每個拆分方案的風險和收益"

# 代理會:

# 1. 掃描所有模組間的依賴關係

# 2. 識別高耦合和低耦合的邊界

# 3. 提出具體的拆分建議和遷移路徑

架構師建議:建立一份「AI 委派矩陣」——明確定義哪些任務適合完全委派、哪些需要協作完成、哪些必須人工處理。例如:

- 完全委派:單元測試撰寫、程式碼格式化、簡單 CRUD API、文件生成

- 協作完成:複雜業務邏輯、效能優化、資料庫 schema 設計

- 人工主導:架構決策、安全審計、合規性審查、系統設計

⚡ 能力趨勢:代理能做什麼

趨勢 2:單一代理演化為協調團隊

架構師視角

這是我認為最具顛覆性的趨勢。報告中提到 Fountain 公司透過階層式多代理協調(Hierarchical Multi-Agent Orchestration)實現了 50% 更快的篩選速度和 2 倍的候選人轉化率。

從架構角度來看,Multi-Agent 系統本質上就是分散式系統設計——這正是我們架構師的核心能力。想像一下:每個 Agent 就是一個微服務,擁有獨立的 context window(類似獨立的記憶體空間),透過 Orchestrator(類似 API Gateway 或 Message Broker)進行協調。

關鍵的架構模式有三種:

- Orchestrator Pattern(編排模式):一個中央代理分配任務、收集結果

- Pipeline Pattern(管線模式):代理們串聯處理,每個處理完交給下一個

- Swarm Pattern(群體模式):多個代理平行處理,最後彙整結果

實戰操作:建構多代理工作流

場景:用多代理系統進行完整的 Feature 開發

# 使用 Claude Code 的 subagent 機制

# 主代理(Orchestrator)接收需求後,分派給專業子代理

# Agent 1: 架構分析代理

$ claude "作為架構分析代理,分析「新增用戶通知系統」這個需求,

識別需要修改的模組、新增的介面、以及對現有系統的影響"

# Agent 2: 測試代理 — 平行撰寫測試

$ claude "作為測試代理,為用戶通知系統撰寫完整的測試案例,

包括單元測試、整合測試、邊界條件測試"

# Agent 3: 實作代理 — 根據架構分析進行開發

$ claude "根據以下架構分析結果,實作用戶通知系統的核心模組..."

# Agent 4: 安全審查代理

$ claude "審查以下程式碼的安全性,檢查 OWASP Top 10 漏洞,

特別關注輸入驗證、SQL Injection、XSS 防護"

進階:使用 Claude Agent SDK 建構自動化多代理系統

# 使用 Claude Agent SDK 建構 Multi-Agent Pipeline

from claude_agent_sdk import Agent, Orchestrator

# 定義專業代理

architect_agent = Agent(

role="architect",

system_prompt="你是資深架構師,負責分析需求並產出技術設計文件",

tools=["file_read", "codebase_search"]

)

test_agent = Agent(

role="tester",

system_prompt="你是測試工程師,負責撰寫全面的測試案例",

tools=["file_write", "test_runner"]

)

impl_agent = Agent(

role="implementer",

system_prompt="你是實作工程師,根據設計文件和測試案例進行開發",

tools=["file_write", "file_edit", "bash"]

)

reviewer_agent = Agent(

role="reviewer",

system_prompt="你是 Code Reviewer,負責品質和安全審查",

tools=["file_read", "security_scanner"]

)

# 建構協調器

orchestrator = Orchestrator(

agents=[architect_agent, test_agent, impl_agent, reviewer_agent],

workflow="sequential", # 或 "parallel", "hierarchical"

checkpoints=["after_design", "after_tests", "after_implementation"]

)

# 執行

result = orchestrator.run("實作用戶通知系統,支援 Email、SMS、Push 三種管道")

架構師建議:不要一開始就追求複雜的多代理架構。先從兩個代理開始——一個負責實作,一個負責審查——建立基本的「雙人檢查」機制,再逐步擴展。

趨勢 3:長時間運行的代理建構完整系統

架構師視角

報告中的 Rakuten 案例極具說服力:Claude Code 在 7 小時內自主完成了在一個 1,250 萬行程式碼庫中的複雜實作,達到 99.9% 的數值精確度。

從架構角度來看,長時間運行的代理本質上需要解決三個核心問題:

- 狀態管理(State Management):代理如何在長時間任務中維持一致的上下文?

- 錯誤恢復(Error Recovery):當代理遇到錯誤時,如何回退並嘗試替代方案?

- 檢查點(Checkpointing):如何設置人工介入點,確保代理沒有偏離方向?

這些問題與我們設計分散式系統時面臨的挑戰如出一轍。Saga Pattern、Circuit Breaker、Retry with Backoff——這些架構模式都可以類比到代理系統的設計中。

實戰操作:設置長時間運行的代理任務

# 場景:讓代理自主重構整個模組

# 步驟 1:提供清晰的目標和邊界

$ claude "重構 src/legacy/payment/ 模組:

目標:將回調式(callback)程式碼遷移到 async/await 模式

邊界:

- 不要修改公開 API 介面

- 保持所有現有測試通過

- 每完成一個檔案就執行測試套件

- 如果測試失敗,回退該檔案的變更並報告問題

檢查點:每處理 5 個檔案暫停,等待我的確認"

# 步驟 2:利用 CLAUDE.md 提供長期上下文

# 在專案根目錄建立 CLAUDE.md,讓代理記住專案規範

# 步驟 3:使用 Git Worktree 隔離工作

$ git worktree add ../payment-refactor feature/payment-async

$ cd ../payment-refactor

$ claude "開始重構工作..."

架構師建議:為長時間代理任務設計「護欄(Guardrails)」——明確定義代理不能做的事情比定義它應該做什麼更重要。這就像 Kubernetes 的 Resource Limits 一樣,防止代理失控。

趨勢 4:人類監督透過智慧協作擴展

架構師視角

報告揭示了一個「協作悖論」:工程師 60% 的工作使用 AI,但只有極小比例能完全委派。這不是 AI 能力不足,而是信任需要逐步建立。

從系統設計角度,這就是漸進式信任模型(Progressive Trust Model):

- Level 0 – 監控模式:代理執行,人類逐行審查(適合初期導入)

- Level 1 – 抽查模式:代理執行,人類抽樣審查(適合建立信任後)

- Level 2 – 異常模式:代理執行 + 自我審查,只有異常才通知人類

- Level 3 – 自主模式:代理全自主執行,人類只在策略層介入

實戰操作:建立智慧監督機制

# 利用 Claude Code 的 Hooks 機制建立自動化審查

# 在 .claude/settings.json 中設定 hooks

{

"hooks": {

"PostToolUse": [

{

"matcher": "Edit|Write",

"command": "npm run lint --fix && npm test -- --bail"

}

],

"PostCommit": [

{

"command": "npm run security-audit"

}

]

}

}

# 這樣每次代理修改程式碼,都會自動:

# 1. 執行 lint 檢查

# 2. 執行測試

# 3. 提交時執行安全掃描

# 形成自動化的品質護欄

場景:使用代理審查代理的產出

# Agent A: 實作功能

$ claude "實作用戶匯出功能,支援 CSV 和 Excel 格式"

# Agent B: 審查 Agent A 的產出(獨立 context,避免偏見)

$ claude "請審查以下程式碼變更(git diff),從以下角度:

1. 安全性:是否有 injection 風險?大檔案是否會 OOM?

2. 效能:匯出 100 萬筆資料時的記憶體和時間複雜度?

3. 可維護性:是否符合專案既有的設計模式?

4. 邊界條件:空資料、特殊字元、併發匯出等情況?"

架構師建議:建立「代理信任儀表板」——追蹤代理產出的品質指標(測試通過率、Code Review 修改率、Bug 回報率),用數據驅動你的信任等級調整。

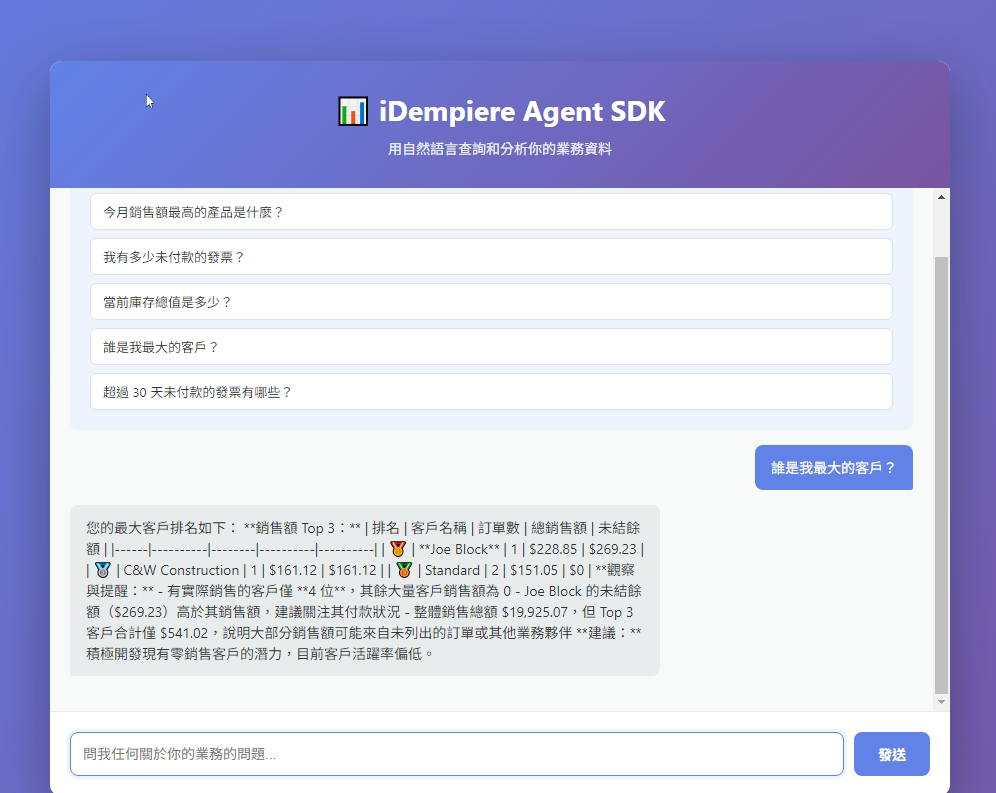

趨勢 5:代理編程擴展到新領域和新用戶

架構師視角

報告指出 AI 正在打破「寫程式的人」和「不寫程式的人」之間的界線。這對架構師來說意味著一個巨大的設計挑戰:如何設計系統讓非技術人員也能安全地進行自動化?

想像一下你的法務團隊用 AI 建立了合約審查自動化、行銷團隊建立了 A/B 測試分析管線、HR 建立了招聘數據儀表板——這些都直接連接到你的核心系統。沒有良好的架構,這就是一場災難。

實戰操作:為非技術團隊建立安全的代理環境

# 場景:讓數據分析師用代理進行資料分析

# 方式 1:提供受限的 Claude Code 環境

# 建立專用的 CLAUDE.md 限制代理行為

# 允許:讀取 /data/ 目錄、執行 Python 腳本、產生圖表

# 禁止:修改任何程式碼、存取生產資料庫、安裝新套件

# 方式 2:使用 MCP (Model Context Protocol) 提供安全的 API 存取

{

"mcpServers": {

"company-data": {

"command": "node",

"args": ["mcp-server/data-access.js"],

"env": {

"DB_ROLE": "readonly",

"MAX_ROWS": "10000"

}

}

}

}

架構師建議:為每個非技術團隊的代理使用場景設計「沙盒(Sandbox)」。就像你不會給實習生 production 的 root 權限一樣,非技術人員的代理也需要明確的權限邊界。使用 Least Privilege 原則,只給代理完成任務所需的最小權限。

📊 影響趨勢:代理將改變什麼

趨勢 6:生產力提升重塑軟體開發經濟

架構師視角

報告中最引人注目的數據是:約 27% 的 AI 輔助工作是「原本不會做的事」。這不只是效率提升,而是價值創造。

從架構師角度,我把這稱為「技術債務清算窗口」。過去那些因為「沒時間」而累積的技術債——老舊的 API 版本、缺失的測試、過時的文件、效能瓶頸——現在都可以系統性地被代理消滅。

報告提到三個乘數效應(Three Multipliers):代理能力提升 × 協調改進 × 人類經驗 = 指數級加速。這不是線性增長,而是複合增長。就像 DevOps 革命一樣,三者相互增強。

實戰操作:系統性消滅技術債

# 場景:用代理批量處理技術債

# 步驟 1:讓代理掃描並分類技術債

$ claude "掃描整個程式碼庫,識別以下類型的技術債:

1. 已廢棄的 API 調用(deprecated warnings)

2. 缺少測試覆蓋的關鍵路徑

3. 硬編碼的配置值

4. 重複的程式碼(DRY 違反)

5. 不一致的錯誤處理模式

按嚴重程度和修復成本排序,產出優先級清單"

# 步驟 2:逐項自動修復

$ claude "根據優先級清單,從最高優先級開始:

- 每修復一項,執行完整測試套件

- 每項修復獨立一個 commit

- 如果修復可能影響其他模組,標記為需要人工審查"

架構師建議:建立「20% 代理時間」制度——每個 Sprint 撥出 20% 的代理運算資源專門處理技術債。用代理來做那些人類「知道該做但沒時間做」的事。

趨勢 7:非技術用例擴展至全組織

架構師視角

報告中 Anthropic 自家法務團隊的案例最具說服力:一位沒有程式碼經驗的律師用 Claude Code 建立了自助服務工具,將行銷審查周轉時間從 2-3 天縮短到 24 小時。

Zapier 更是達到了 89% 的全組織 AI 採用率,部署了 800+ 個內部 AI 代理。

作為架構師,這意味著你需要開始思考「代理治理(Agent Governance)」:誰可以建立代理?代理可以存取哪些系統?如何追蹤和審計代理的行為?代理出錯時的責任歸屬?

實戰操作:建構組織級代理平台

# 架構建議:建立內部的 Agent Platform

# 1. 定義代理模板(Agent Templates)

# marketing-agent-template.yaml

name: marketing-automation-agent

permissions:

read: [marketing-data, analytics-api]

write: [marketing-reports, draft-content]

execute: [data-analysis-scripts]

forbidden: [production-db, source-code, deployment]

resource_limits:

max_tokens_per_day: 1000000

max_api_calls: 500

audit:

log_all_actions: true

alert_on: [data-access, external-api-call]

# 2. 建立自助服務入口

# 非技術人員透過 Web UI 與代理互動

# 所有操作都在沙盒環境中執行

# 3. 監控儀表板

# 追蹤全組織的代理使用情況:

# - 各部門使用量和成本

# - 代理產出的品質指標

# - ROI 分析(節省的人力時間 vs 代理成本)

架構師建議:把「代理治理」視為與「資料治理」同等重要的架構議題。建立 Agent Center of Excellence (ACoE),制定組織級的代理使用政策、安全標準和最佳實踐。

趨勢 8:雙重用途風險需要安全優先架構

架構師視角

這是最被低估但最重要的趨勢。報告指出:同樣的 AI 能力既能強化防禦,也能助長攻擊。

從架構角度,這意味著安全不再是事後補救,而必須是設計時的第一考量(Security by Design)。當任何工程師都能用 AI 進行深度安全審查時,攻擊者也能用同樣的 AI 尋找漏洞。

關鍵的架構原則:

- Zero Trust Architecture:不信任任何內部或外部的代理輸出

- Defense in Depth:多層防禦,即使一層被突破仍有保護

- Shift Left Security:在開發早期就嵌入安全檢查

實戰操作:用代理建立安全防線

# 場景 1:自動化安全審查管線

# 在 CI/CD Pipeline 中嵌入 AI 安全審查

name: AI Security Review

on: [pull_request]

jobs:

security-review:

steps:

- name: AI Security Scan

run: |

claude "審查這個 PR 的所有變更:

1. OWASP Top 10 漏洞掃描

2. 硬編碼的密鑰或憑證

3. SQL/NoSQL Injection 風險

4. XSS 和 CSRF 防護

5. 權限提升風險

6. 敏感資料洩漏

以 SARIF 格式輸出結果"

# 場景 2:用代理進行威脅建模

$ claude "對以下系統架構進行威脅建模(STRIDE 方法):

- 前端:React SPA

- API Gateway:Kong

- 後端:Spring Boot 微服務群

- 資料庫:PostgreSQL + Redis

- 訊息佇列:Kafka

- 部署:Kubernetes on AWS"

# 場景 3:AI 紅藍對抗

# 用一個代理扮演攻擊者(Red Team)尋找漏洞

# 另一個代理扮演防禦者(Blue Team)修補漏洞

架構師建議:建立「AI 紅藍對抗」機制——用一個代理扮演攻擊者尋找漏洞,另一個代理扮演防禦者修補漏洞。這種持續的對抗演練能顯著提升系統安全性。

🎯 我的行動建議:2026 年架構師優先事項

綜合以上 8 大趨勢,我給出以下具體的行動清單:

立即行動(本月)

- 建立 CLAUDE.md:為每個專案建立代理上下文文件,定義程式碼規範、禁止事項、測試要求

- 設定 Hooks:配置自動化品質護欄,確保代理每次修改都通過基本檢查

- 導入雙代理審查:一個代理寫程式碼,另一個代理審查,建立基本的品質保障

短期規劃(本季)

- 建立 AI 委派矩陣:明確定義團隊中哪些任務適合委派給代理

- 啟動技術債清理專案:利用代理系統性處理積壓的技術債

- 設計代理安全框架:定義代理的權限邊界、審計機制、異常處理

中期布局(今年)

- 建構多代理協調系統:根據團隊需求設計 Orchestrator 架構

- 推動非技術團隊採用:為業務團隊建立安全的代理沙盒環境

- 建立 Agent Governance 體系:制定組織級的代理使用政策和治理框架

結語

這份報告的核心訊息很清楚:2026 年的軟體開發正在從「寫程式碼」轉向「指揮寫程式碼的代理」。但這不是要取代工程師——恰恰相反,它要求工程師具備更高層次的思考能力:架構設計、系統思維、品質判斷、安全意識。

作為架構師,我們正處於一個前所未有的機遇期。那些能夠設計良好的代理協作架構、建立有效的人機協作模式、並在組織層面推動代理治理的架構師,將成為這場變革的引領者。

最後的忠告:不要等到完美才開始。今天就打開 Claude Code,給它一個你一直拖著沒做的重構任務,開始建立你的代理協作經驗。實踐出真知。

本文基於 Anthropic《2026 Agentic Coding Trends Report》撰寫。報告原文共 18 頁,涵蓋基礎趨勢、能力趨勢、影響趨勢三大類別共 8 個趨勢預測。